Das Wichtigste im Überblick:

- Two Towers Consulting bietet umfassende rechtliche Beratung zur Implementierung KI-konformer Compliance-Systeme

- KI-Compliance ist entscheidend für den rechtssicheren Einsatz von KI-Technologien in Unternehmen

- Hauptherausforderungen sind Datenschutz, Diskriminierungsvermeidung und Transparenz von KI-Systemen

Jetzt Angebot anfordern!

In einer Welt, in der künstliche Intelligenz (KI) zunehmend Einzug in Unternehmensprozesse hält, stehen Unternehmen vor der Herausforderung, innovative Technologien zu nutzen und gleichzeitig rechtliche und ethische Standards einzuhalten. KI-Compliance ist dabei der Schlüssel, um die Potenziale der KI voll auszuschöpfen, ohne rechtliche Grenzen zu überschreiten oder Reputationsrisiken einzugehen.

Die Komplexität der rechtlichen Anforderungen im Bereich KI verunsichert viele Unternehmen. Datenschutzverletzungen, mögliche Diskriminierung durch KI-Systeme oder mangelnde Transparenz in KI-gestützten Entscheidungsprozessen sind nur einige der Risiken, die es zu adressieren gilt. Als erfahrene Wirtschaftskanzlei mit Fokus auf Compliance-Recht unterstützt Two Towers Consulting Sie dabei, diese Herausforderungen zu meistern und KI-Technologien rechtssicher in Ihrem Unternehmen zu implementieren.

Rechtliche Grundlagen der KI-Compliance

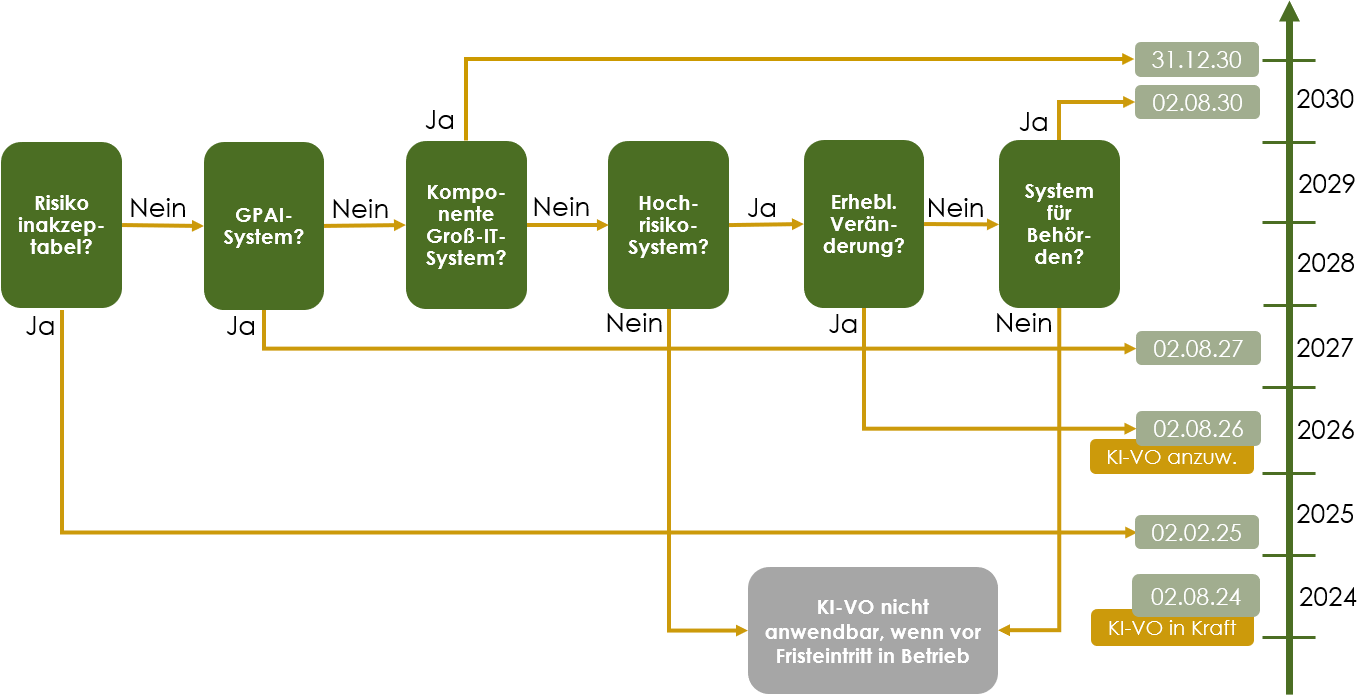

Die neue EU-KI-Verordnung („KI-VO“; engl.: „AI Act“) ist politisch durch und wird noch in den nächsten Monaten in Kraft treten. Die tatsächliche Anwendbarkeit der einzelnen Vorgaben aus der KI-VO ist zeitlich gestaffelt. Während die Verbote von KI-Systemen mit inakzeptablen Risiken bereits sechs Monate nach Inkrafttreten der Verordnung greifen, werden die meisten Normen in zwei Jahren anwendbar sein. Die rechtlichen Rahmenbedingungen für den Einsatz von KI-Technologien sind vielschichtig und entwickeln sich stetig weiter. Zu den wichtigsten Regelwerken zählen:

- Die EU-Verordnung über Künstliche Intelligenz (KI-Verordnung)

- Die Datenschutz-Grundverordnung (DSGVO)

- Das Allgemeine Gleichbehandlungsgesetz (AGG)

- Branchenspezifische Regulierungen

Zentrale Herausforderungen der KI-Compliance

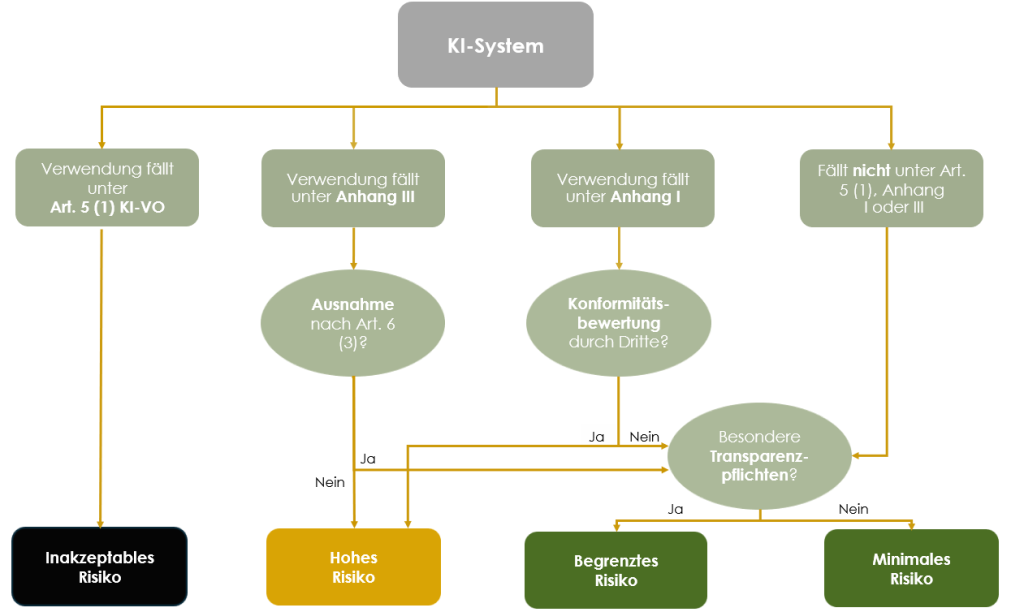

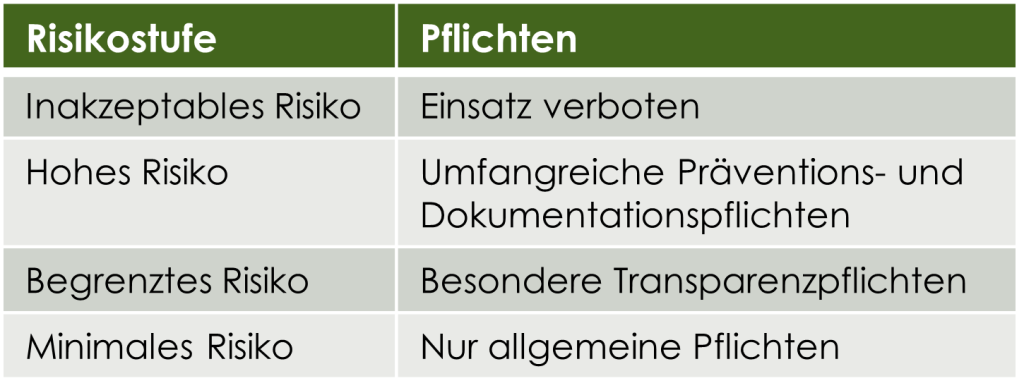

1. Rechtliche Einordnung von KI-Anwendungen

Die korrekte rechtliche Einordnung verschiedener KI-Anwendungen ist der erste Schritt zu einer effektiven Compliance-Strategie. Je nach Einsatzgebiet und Funktionsweise der KI können unterschiedliche rechtliche Anforderungen gelten.

2. Transparenz und Erklärbarkeit von KI-Systemen

Eine der größten Herausforderungen im Bereich KI-Compliance ist die Gewährleistung von Transparenz und Erklärbarkeit. KI-Systeme müssen nachvollziehbar und ihre Entscheidungen erklärbar sein. Dies ist nicht nur eine rechtliche Anforderung, sondern auch entscheidend für das Vertrauen in KI-gestützte Prozesse.

3. Verantwortlichkeiten bei KI-gestützten Entscheidungen

Wer trägt die Verantwortung, wenn eine KI eine fehlerhafte Entscheidung trifft? Diese Frage ist zentral für die rechtliche Absicherung beim Einsatz von KI.

4. Datenschutz-Compliance in KI-Projekten

KI-Systeme basieren oft auf der Verarbeitung großer Datenmengen, was besondere datenschutzrechtliche Herausforderungen mit sich bringt. Die Einhaltung der DSGVO und anderer datenschutzrechtlicher Bestimmungen ist unerlässlich.

5. Vermeidung von KI-induzierter Diskriminierung

KI-Systeme können unbeabsichtigt diskriminierende Entscheidungen treffen, wenn sie mit voreingenommenen Daten trainiert wurden. Die Vermeidung solcher Diskriminierungen ist nicht nur ethisch geboten, sondern auch rechtlich verpflichtend.

Jetzt Angebot anfordern!

Handlungsempfehlung: Unternehmensinterne KI-Richtlinie

Bis zur Anwendbarkeit der meisten Normen in zwei Jahre, sollten Unternehmen die Zeit nutzen, um möglichst viel aus den Möglichkeiten der KI-Transformation herauszuholen, aber dabei stets compliant zu bleiben.

Ein besonders wichtiges Instrument für das Management von KI-Compliance ist eine unternehmensinterne KI-Richtlinie. Mit einer KI-Richtlinie können Unternehmen eine belastbare Governance-Struktur etablieren und Standards und Strategien für den Einsatz von KI-Systemen festlegen. Somit schafft eine KI-Richtlinie Klarheit und Erwartbarkeit für die Belegschaft und ermutigt Mitarbeiter, innovative Projekte mit Hilfe von KI-Technologie zu verfolgen. Gleichzeitig schützt eine gut gestaltete und erfolgreich implementierte Richtlinie vor den vielfältigen Risiken, die durch den Einsatz von KI in den Bereichen Informationsschutz, Urheberrecht, Datenschutz, Produktsicherheit etc. auftreten können.

Eine KI-Richtlinie muss daher immer mehrere Ziele verfolgen. Dazu gehört insbesondere, die Mitarbeiter zum Einsatz von KI-Systemen zu ermutigen und Innovation im Unternehmen zu fördern. Gleichzeitig müssen die rechtlichen Vorgaben aus KI-VO, DSGVO etc. eingehalten, der Schutz von Betriebsgeheimnissen und weiteren vertraulichen und sensiblen Information des Unternehmens sichergestellt, und der Schutz der Rechtsgüter Dritter (Datenschutz, immaterielle Güter wie Urheberecht und Patente, Auskunftsansprüche) garantiert werden. Da sich hier regelmäßig Spannungsfelder ergeben, muss eine KI-Richtlinie klar definieren, nach welchem Leitbild und Prinzipien KI-Systeme im Unternehmen entwickelt und eingesetzt werden dürfen.

Auf der operativen Ebene muss ein KI-Richtlinie im Unternehmen Klarheit über eingesetzte Systeme, damit verfolgte Zwecke und die damit verbundenen Abhängigkeiten und Beziehungen herstellen sowie Abläufe, Verantwortlichkeiten, Aufgaben und Rollen klarstellen. Für einen erfolgreichen Einsatz muss die KI-Richtlinie Bewusstsein für Risiken und Chancen schaffen und dabei nicht nur diese Risiken eindämmen, sondern auch vermeiden, dass Mitarbeiter aus übergroßer Vorsicht auf den Einsatz von KI-Systemen verzichten. Daher muss die notwendige Wissensvermittlung (KI-Kompetenz) eine Zielstellung der KI-Richtlinie sein. Ergänzt werden muss dies durch zusätzliche Schulungen der Beschäftigten. Gleichzeitig muss die Richtlinie ermöglichen, dass die notwendige Transparenz sowohl intern also auch gegenüber externen Betroffenen wie Kunden, Geschäftspartnern oder Bewerbern gegeben ist.

Um diese Ziele zu erreichen, sollte eine KI-Richtlinie zumindest das Folgende regeln:

- Erfassen und Dokumentieren der eingesetzten KI-Systemen: Hierbei muss auch geklärt werden, wie das Unternehmen damit umgeht, wenn Softwareanbieter ihre Produkte nachträglich mit KI-Technologie anreichern, sowie es Microsoft mit dem Copilot vorgenommen hat.

- Nutzung frei verfügbarer KI-Angebote

- Sicherstellung und Bewertung der Zuverlässigkeit des Outputs von KI-Systemen

- Risikoeinstufung von KI-Systemen und Durchführen von Risk Assessments

- Umgang mit KI-Systemen, die als Hoch-Risiko eingestuft wurden

- Ablauf für das Entwickeln oder Einführen eines neuen KI-Systems

- Vorgaben für die Evaluation bestehender KI-Systeme

- Erkennen und Mitigieren von Risiken für das Unternehmen

- Erkennen und Mitigieren von Risiken für Dritte

- Umgang mit Betroffenenrechten und Beschwerdemanagement

- Vorgaben für Training und Wissensvermittlung

- Vorgaben für die Sicherstellung der Transparenzverpflichtungen

Das Thema Haftung wird selbstverständlich auch eine wichtige Rolle spielen. Hierzu wird der KI-VO bald eine EU-KI-Haftungsrichtlinie an die Seite gestellt werden. Für diese Richtlinie existiert bisher ein Entwurf der EU-Kommission. Sobald die EU-KI-Haftungsrichtlinie in deutsches Recht umgesetzt wurde, sollte die bisherige interne KI-Governance-Struktur noch einmal überprüft werden.

KI-Systeme werden bereits jetzt umfangreich in allen Unternehmen genutzt und entwickelt. Compliance-Verantwortliche sollten also keine Zeit verlieren, denn bereits heute muss dabei geltendes Recht eingehalten werden.

KI-Compliance als Wettbewerbsvorteil

KI-Compliance ist mehr als nur die Erfüllung rechtlicher Anforderungen. Ein proaktiver und ganzheitlicher Ansatz zur KI-Compliance kann zu einem echten Wettbewerbsvorteil werden. Er schafft Vertrauen bei Kunden, Mitarbeitern und Geschäftspartnern, minimiert rechtliche und finanzielle Risiken und ermöglicht es Ihrem Unternehmen, die Potenziale von KI voll auszuschöpfen.

Two Towers Consulting steht Ihnen als erfahrener Partner zur Seite, um Ihre KI-Anwendungen rechtssicher und ethisch einwandfrei zu gestalten. Unsere Kombination aus technischem Verständnis und rechtlicher Expertise im KI-Bereich ermöglicht es uns, maßgeschneiderte Lösungen zu entwickeln, die Ihr Unternehmen für die Herausforderungen der KI-Ära rüsten.

Lassen Sie uns gemeinsam Ihre KI-Compliance-Strategie entwickeln und umsetzen. Kontaktieren Sie uns für ein kostenloses Erstgespräch, in dem wir Ihre spezifischen KI-Compliance-Herausforderungen analysieren und erste Lösungsansätze skizzieren.

Praktische Tipps für Ihre KI-Compliance

Um Ihnen den Einstieg in eine effektive KI-Compliance zu erleichtern, haben wir einige praktische Tipps zusammengestellt:

1. Führen Sie regelmäßige KI-Risikobewertungen durch

Etablieren Sie einen Prozess zur regelmäßigen Überprüfung und Bewertung der Risiken Ihrer KI-Systeme. Nutzen Sie dafür eine strukturierte Checkliste, die alle relevanten rechtlichen und ethischen Aspekte abdeckt.

2. Dokumentieren Sie KI-Entscheidungsprozesse

Implementieren Sie ein System zur lückenlosen Dokumentation aller KI-gestützten Entscheidungsprozesse. Dies erhöht nicht nur die Transparenz, sondern erleichtert auch die Nachvollziehbarkeit im Falle von Überprüfungen oder Streitigkeiten.

3. Etablieren Sie ein KI-Ethik-Board

Ein internes KI-Ethik-Board kann bei der Bewertung ethischer Fragen im Zusammenhang mit KI-Anwendungen unterstützen und zur Entwicklung unternehmensweiter Richtlinien für den ethischen Einsatz von KI beitragen.

4. Schulen Sie Ihre Mitarbeiter

Regelmäßige Schulungen zum Thema KI-Compliance sensibilisieren Ihre Mitarbeiter für potenzielle Risiken und befähigen sie, compliant mit KI-Systemen zu arbeiten.

5. Bleiben Sie auf dem Laufenden

Die rechtlichen Rahmenbedingungen für KI entwickeln sich ständig weiter. Stellen Sie sicher, dass Ihr Unternehmen über Veränderungen informiert bleibt und Ihre Compliance-Strategie entsprechend anpasst.

Jetzt Angebot anfordern!

Unsere KI-Beratungsleistungen

Künstliche Intelligenz transformiert Unternehmen und Anwendungen grundlegend. Viele Organisationen berücksichtigen bereits ethische Aspekte bei KI-Projekten – eine gute Basis für die Umsetzung rechtlicher Vorgaben.

Die EU-KI-Verordnung setzt nun weltweit Maßstäbe mit verbindlichen Regeln für Entwickler und Anwender. Zusätzlich sind weitere Gesetze wie die DSGVO zu beachten. Jedes Unternehmen muss sich mit diesen Anforderungen auseinandersetzen.

Wir unterstützen Sie dabei, diese Vorgaben pragmatisch und effizient in Ihre Abläufe zu integrieren. Unsere Experten aus Recht und Compliance helfen Ihnen, regulatorische Risiken zu minimieren und gleichzeitig Ihr Kerngeschäft nicht zu beeinträchtigen.

Unser Leistungsspektrum umfasst:

- Entwicklung eines KI-Compliance-Frameworks

- Mapping relevanter Anforderungen

- KI-Schulungen zur Förderung der „AI Literacy“

- Durchführung von Assessments und Erstellung erforderlicher Dokumentation

- Umsetzung datenschutzkonformer KI-Lösungen

Mit unserem ganzheitlichen Ansatz bleiben Sie bei KI-Projekten rechtlich auf der sicheren Seite, ohne Ihre Organisation zu überlasten. Mehr Informationen finden Sie hier.

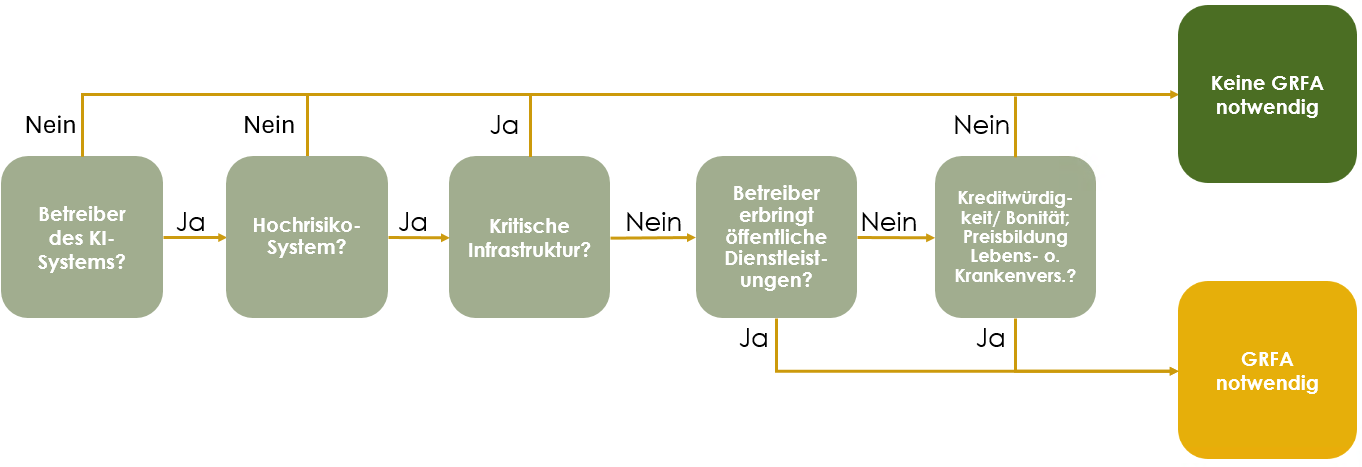

Wir beraten Sie gern. Sprechen Sie uns an. Ihnen gefallen unsere Entscheidungsbäume und Sie wollen keine relevanten Entwicklungen im Bereich der KI-Regulierung verpassen? Abonnieren Sie unseren Newsletter, um in Sachen KI und Datenschutz stets auf dem aktuellen Stand zu bleiben.

Häufig gestellte Fragen

KI-Compliance bezeichnet die Einhaltung rechtlicher und ethischer Standards beim Einsatz von KI-Technologien in Unternehmen. Dies umfasst Aspekte wie Datenschutz, Nicht-Diskriminierung, Transparenz und Verantwortlichkeit bei KI-gestützten Entscheidungen.

Zu den wichtigsten Regelwerken zählen die EU-Verordnung über Künstliche Intelligenz, die DSGVO, das AGG sowie branchenspezifische Regulierungen. Die genauen Anforderungen hängen vom Einsatzbereich und der Art der KI-Anwendung ab.

Wichtig sind regelmäßige Überprüfungen der Trainingsdaten und Ergebnisse auf Voreingenommenheit, die Implementierung von Fairness-Metriken und die Diversifizierung der Entwicklungsteams. Unsere Experten unterstützen Sie bei der Entwicklung geeigneter Strategien.

KI-Systeme sollten umfassend dokumentiert werden, einschließlich der verwendeten Daten, Algorithmen, Trainingsmethoden und Entscheidungsprozesse. Dies dient der Transparenz und erleichtert mögliche behördliche Überprüfungen.

Wir empfehlen, mindestens jährlich eine umfassende KI-Risikobewertung durchzuführen. Bei signifikanten Änderungen am System oder relevanten rechtlichen Entwicklungen sollten zusätzliche Bewertungen erfolgen.

Ein KI-Ethik-Board ist ein internes Gremium, das ethische Fragen im Zusammenhang mit KI-Anwendungen bewertet und Richtlinien entwickelt. Für Unternehmen mit umfangreichen oder sensiblen KI-Anwendungen kann ein solches Board sehr sinnvoll sein.

Die Strafen können je nach Verstoß und anwendbarem Recht erheblich variieren. Sie reichen von Bußgeldern über Schadensersatzforderungen bis hin zu Reputationsschäden und behördlichen Auflagen.

Regelmäßige Schulungen, klare Richtlinien und eine offene Kommunikationskultur sind entscheidend.

Eine proaktive Strategie minimiert rechtliche und finanzielle Risiken, schafft Vertrauen bei Stakeholdern, erleichtert behördliche Prüfungen und kann zu einem Wettbewerbsvorteil werden.